algoritmo k-vecinos más cercanos

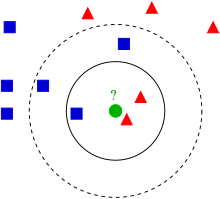

En estadística , el algoritmo de k- vecinos más cercanos ( k -NN ) es un método de aprendizaje supervisado no paramétrico desarrollado por primera vez por Evelyn Fix y Joseph Hodges en 1951, [1] y luego ampliado por Thomas Cover . [2] Se utiliza para clasificación y regresión . En ambos casos, la entrada consta de los k ejemplos de entrenamiento más cercanos en un conjunto de datos . El resultado depende de si k -NN se usa para la clasificación o la regresión:

k -NN es un tipo de clasificación donde la función solo se aproxima localmente y todos los cálculos se difieren hasta la evaluación de la función. Dado que este algoritmo se basa en la distancia para la clasificación, si las características representan diferentes unidades físicas o vienen en escalas muy diferentes, la normalización de los datos de entrenamiento puede mejorar drásticamente su precisión. [3]

Tanto para la clasificación como para la regresión, una técnica útil puede ser asignar pesos a las contribuciones de los vecinos, de modo que los vecinos más cercanos contribuyan más al promedio que los más distantes. Por ejemplo, un esquema común de ponderación consiste en dar a cada vecino un peso de 1/ d , donde d es la distancia al vecino. [4]

Los vecinos se toman de un conjunto de objetos para los cuales se conoce la clase (para la clasificación k -NN) o el valor de la propiedad del objeto (para la regresión k -NN). Esto se puede considerar como el conjunto de entrenamiento para el algoritmo, aunque no se requiere un paso de entrenamiento explícito.