Mínimos cuadrados ordinarios

En estadística , los mínimos cuadrados ordinarios ( OLS ) son un tipo de método de mínimos cuadrados lineales para estimar los parámetros desconocidos en un modelo de regresión lineal . OLS elige los parámetros de una función lineal de un conjunto de variables explicativas por el principio de mínimos cuadrados : minimizando la suma de los cuadrados de las diferencias entre la variable dependiente observada (valores de la variable que se observa) en el conjunto de datos dado y los predichos por la función lineal de la variable independiente .

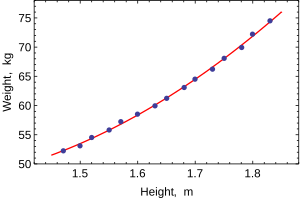

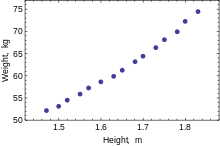

Geométricamente, esto se ve como la suma de las distancias al cuadrado, paralelas al eje de la variable dependiente, entre cada punto de datos en el conjunto y el punto correspondiente en la superficie de regresión: cuanto más pequeñas sean las diferencias, mejor se ajusta el modelo a los datos. . El estimador resultante se puede expresar mediante una fórmula simple, especialmente en el caso de una regresión lineal simple , en la que hay un solo regresor en el lado derecho de la ecuación de regresión.

El estimador OLS es consistente cuando los regresores son exógenos y, según el teorema de Gauss-Markov , es óptimo en la clase de estimadores lineales insesgados cuando los errores son homocedásticos y no correlacionados en serie . Bajo estas condiciones, el método de MCO proporciona una estimación imparcial de media de varianza mínima cuando los errores tienen varianzas finitas . Bajo el supuesto adicional de que los errores se distribuyen normalmente , OLS es el estimador de máxima verosimilitud .

Supongamos que los datos consisten en observaciones . Cada observación incluye una respuesta escalar y un vector de columna de parámetros (regresores), es decir, . En un modelo de regresión lineal , la variable de respuesta , es una función lineal de los regresores:

![{\displaystyle \mathbf {x} _{i}=\left[x_{i1},x_{i2},\dots,x_{ip}\right]^{\mathsf {T}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/daad19b2eabb379c5fce21e00f9e77f64b7a2808)