La distribución normal generalizada o distribución gaussiana generalizada (GGD) es una de dos familias de distribuciones de probabilidad continua paramétricas en la línea real . Ambas familias agregan un parámetro de forma a la distribución normal . Para distinguir las dos familias, a continuación se hace referencia a ellas como "versión 1" y "versión 2". Sin embargo, esta no es una nomenclatura estándar.

Versión 1

Función de densidad de probabilidad  | |||

Función de distribución acumulativa  | |||

| Parámetros | ubicación ( real ) escala (positiva, real ) forma (positiva, real ) | ||

|---|---|---|---|

| Apoyo | |||

| |||

| CDF | [1] donde es un parámetro de forma y es un parámetro de tasa. donde es un parámetro de forma, es un parámetro de escala y es la función gamma inferior incompleta no normalizada . | ||

| Cuantil | | ||

| Significar | |||

| Mediana | |||

| Modo | |||

| Diferencia | |||

| Oblicuidad | 0 | ||

| Ex. curtosis | |||

| Entropía | [2] | ||

También conocida como distribución de potencia exponencial , o distribución de error generalizada , se trata de una familia paramétrica de distribuciones simétricas. Incluye todas las distribuciones normales y de Laplace , y como casos límite incluye todas las distribuciones uniformes continuas en intervalos acotados de la línea real.

Esta familia incluye la distribución normal cuando (con media y varianza ) e incluye la distribución de Laplace cuando. Como, la densidad converge puntualmente a una densidad uniforme en.

Esta familia permite colas que son más pesadas de lo normal (cuando ) o más ligero de lo normal (cuando ). Es una forma útil de parametrizar un continuo de densidades platicúrticas simétricas que van desde lo normal () a la densidad uniforme (), y un continuo de densidades leptocúrticas simétricas que se extienden desde Laplace () a la densidad normal ().

Estimación de parámetros

Se ha estudiado la estimación de parámetros mediante la máxima verosimilitud y el método de momentos . [3] Las estimaciones no tienen forma cerrada y deben obtenerse numéricamente. También se han propuesto estimadores que no requieren cálculo numérico. [4]

La función de verosimilitud logarítmica normal generalizada tiene infinitas derivadas continuas (es decir, pertenece a la clase C ∞ de funciones suaves ) solo sies un número entero positivo, par. De lo contrario, la función tienederivadas continuas. Como resultado, los resultados estándar de consistencia y normalidad asintótica de las estimaciones de máxima verosimilitud de aplicar solo cuando .

Estimador de máxima verosimilitud

Es posible ajustar la distribución normal generalizada adoptando un método de máxima verosimilitud aproximada . [5] [6] Con inicialmente ajustado al primer momento de la muestra , se estima mediante un procedimiento iterativo de Newton-Raphson , a partir de una estimación inicial de,

donde

es el primer momento estadístico de los valores absolutos yes el segundo momento estadístico . La iteración es

donde

y

y donde y son la función digamma y la función trigamma .

Dado un valor para , es posible estimar encontrando el mínimo de:

Por fin se evalúa como

Para , la mediana es un estimador más apropiado de . Una vez es estimado, y puede estimarse como se describe arriba. [7]

Aplicaciones

Esta versión de la distribución normal generalizada se ha utilizado en el modelado cuando la concentración de valores alrededor de la media y el comportamiento de la cola son de particular interés. [8] [9] Se pueden usar otras familias de distribuciones si el foco está en otras desviaciones de la normalidad. Si la simetría de la distribución es el interés principal, se puede utilizar la familia normal sesgada o la versión 2 de la familia normal generalizada que se analiza a continuación. Si el comportamiento de la cola es el interés principal, se puede utilizar la familia t de student , que se aproxima a la distribución normal a medida que los grados de libertad aumentan hasta el infinito. La distribución t, a diferencia de esta distribución normal generalizada, obtiene colas más pesadas que las normales sin adquirir unacúspide en el origen.

Propiedades

Momentos

Dejar ser cero media distribución gaussiana generalizada de la forma y parámetro de escala . Los momentos de existen y son finitos para cualquier k mayor que -1. Para cualquier entero k no negativo, los momentos centrales simples son [10]

Conexión con funciones positivas definidas

La función de densidad de probabilidad de esta versión de la distribución normal generalizada es una función definida positiva para . [11] [12]

Divisibilidad infinita

Esta versión de la distribución gaussiana generalizada es una distribución infinitamente divisible si y solo si. [13]

Generalizaciones

La distribución normal generalizada multivariada, es decir, el producto de distribuciones de potencia exponenciales con el mismo y parámetros, es la única densidad de probabilidad que se puede escribir en la forma y tiene marginales independientes. [14] Los resultados para el caso especial de la distribución normal multivariante se atribuyen originalmente a Maxwell . [15]

Versión 2

Función de densidad de probabilidad  | |||

Función de distribución acumulativa  | |||

| Parámetros | ubicación ( real ) escala (positiva, real ) forma ( real ) | ||

|---|---|---|---|

| Apoyo | |||

| , donde es el pdf normal estándar | |||

| CDF | , donde es el CDF normal estándar | ||

| Significar | |||

| Mediana | |||

| Diferencia | |||

| Oblicuidad | |||

| Ex. curtosis | |||

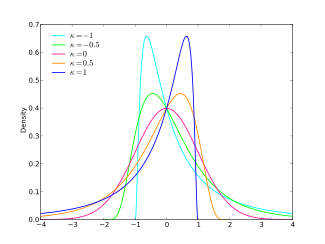

Esta es una familia de distribuciones de probabilidad continuas en las que el parámetro de forma se puede utilizar para introducir sesgo. [16] [17] Cuando el parámetro de forma es cero, se obtiene la distribución normal. Los valores positivos del parámetro de forma producen distribuciones sesgadas a la izquierda limitadas a la derecha, y los valores negativos del parámetro de forma producen distribuciones sesgadas a la derecha limitadas a la izquierda. Solo cuando el parámetro de forma es cero, la función de densidad para esta distribución es positiva en toda la línea real: en este caso, la distribución es una distribución normal ; de lo contrario, las distribuciones se desplazan y posiblemente se invierten las distribuciones log-normales .

Estimación de parámetros

Los parámetros se pueden estimar mediante la estimación de máxima verosimilitud o el método de momentos. Las estimaciones de los parámetros no tienen una forma cerrada, por lo que se deben utilizar cálculos numéricos para calcular las estimaciones. Dado que el espacio muestral (el conjunto de números reales donde la densidad es distinta de cero) depende del valor real del parámetro, algunos resultados estándar sobre el rendimiento de las estimaciones de parámetros no se aplicarán automáticamente al trabajar con esta familia.

Aplicaciones

Esta familia de distribuciones se puede utilizar para modelar valores que pueden estar distribuidos normalmente o que pueden estar sesgados hacia la derecha o hacia la izquierda en relación con la distribución normal. La distribución normal sesgada es otra distribución que es útil para modelar las desviaciones de la normalidad debido a la asimetría. Otras distribuciones utilizadas para modelar datos asimétricos incluyen las distribuciones gamma , lognormal y Weibull , pero estas no incluyen las distribuciones normales como casos especiales.

Las dos familias normales generalizadas descritas aquí, como la familia normal sesgada , son familias paramétricas que amplían la distribución normal agregando un parámetro de forma. Debido al papel central de la distribución normal en probabilidad y estadística, muchas distribuciones se pueden caracterizar en términos de su relación con la distribución normal. Por ejemplo, las distribuciones logarítmica normal , normal plegada y normal inversa se definen como transformaciones de un valor distribuido normalmente, pero a diferencia de las familias normal generalizada y normal asimétrica, estas no incluyen las distribuciones normales como casos especiales.

En realidad, todas las distribuciones con varianza finita están en el límite altamente relacionadas con la distribución normal. La distribución t de Student, la distribución de Irwin-Hall y la distribución de Bates también amplían la distribución normal e incluyen en el límite la distribución normal. Por lo tanto, no hay una razón sólida para preferir la distribución normal "generalizada" de tipo 1, por ejemplo, sobre una combinación de Student-t y un Irwin-Hall extendido normalizado; esto incluiría, por ejemplo, la distribución triangular (que no puede ser modelada por la distribución gaussiana generalizada tipo 1).

Una distribución simétrica que puede modelar tanto la cola (larga y corta) comoel comportamiento del centro (como plano, triangular o gaussiano) de forma completamente independiente podría derivarse, por ejemplo, utilizando X = IH / chi.

Ver también

- Distribución normal compleja

- Distribución normal sesgada

Referencias

- ^ a b Griffin, Maryclare. "Trabajando con la distribución de energía exponencial usando gnorm" . Github, paquete gnorm . Consultado el 26 de junio de 2020 .

- ^ Nadarajah, Saralees (septiembre de 2005). "Una distribución normal generalizada". Revista de estadísticas aplicadas . 32 (7): 685–694. doi : 10.1080 / 02664760500079464 .

- ^ Varanasi, MK; Aazhang, B. (octubre de 1989). "Estimación de densidad gaussiana generalizada paramétrica". Revista de la Sociedad Americana de Acústica . 86 (4): 1404-1415. doi : 10.1121 / 1.398700 .

- ↑ Domínguez-Molina, J. Armando; González-Farías, Graciela; Rodríguez-Dagnino, Ramón M. "Un procedimiento práctico para estimar el parámetro de forma en la distribución gaussiana generalizada" (PDF) . Consultado el 3 de marzo de 2009 . Cite journal requiere

|journal=( ayuda ) - ^ Varanasi, MK; Aazhang B. (1989). "Estimación de densidad gaussiana generalizada paramétrica". J. Acoust. Soc. Soy. 86 (4): 1404-1415. doi : 10.1121 / 1.398700 .

- ^ Hacer, MN; Vetterli, M. (febrero de 2002). "Recuperación de textura basada en ondas utilizando densidad gaussiana generalizada y distancia Kullback-Leibler" . Transacción sobre procesamiento de imágenes . 11 (2): 146-158. doi : 10.1109 / 83.982822 . PMID 18244620 .

- ^ Varanasi, Mahesh K .; Aazhang, Behnaam (1 de octubre de 1989). "Estimación de densidad gaussiana generalizada paramétrica". La Revista de la Sociedad Estadounidense de Acústica . 86 (4): 1404-1415. doi : 10.1121 / 1.398700 . ISSN 0001-4966 .

- ^ Liang, Faming; Liu, Chuanhai; Wang, Naisyin (abril de 2007). "Un método bayesiano secuencial robusto para la identificación de genes expresados diferencialmente" . Statistica Sinica . 17 (2): 571–597. Archivado desde el original el 9 de octubre de 2007 . Consultado el 3 de marzo de 2009 .

- ^ Caja, George EP ; Tiao, George C. (1992). Inferencia bayesiana en análisis estadístico . Nueva York: Wiley. ISBN 978-0-471-57428-6.

- ^ Saralees Nadarajah (2005) Una distribución normal generalizada, Journal of Applied Statistics, 32: 7, 685-694, DOI: 10.1080 / 02664760500079464

- ^ Dytso, Alex; Bustin, Ronit; Pobre, H. Vincent; Shamai, Shlomo (2018). "Propiedades analíticas de distribuciones gaussianas generalizadas" . Revista de Distribuciones y Aplicaciones Estadísticas . 5 (1): 6. doi : 10.1186 / s40488-018-0088-5 .

- ^ Bochner, Salomon (1937). "Leyes estables de probabilidad y funciones completamente monótonas" . Diario de matemáticas de Duke . 3 (4): 726–728. doi : 10.1215 / s0012-7094-37-00360-0 .

- ^ Dytso, Alex; Bustin, Ronit; Pobre, H. Vincent; Shamai, Shlomo (2018). "Propiedades analíticas de distribuciones gaussianas generalizadas" . Revista de Distribuciones y Aplicaciones Estadísticas . 5 (1): 6. doi : 10.1186 / s40488-018-0088-5 .

- ^ Sinz, Fabián; Gerwinn, Sebastian; Bethge, Matthias (mayo de 2009). "Caracterización de la distribución normal p-generalizada" . Revista de análisis multivariante . 100 (5): 817–820. doi : 10.1016 / j.jmva.2008.07.006 .

- ↑ Kac, M. (1939). "Sobre una caracterización de la distribución normal". Revista Estadounidense de Matemáticas . 61 (3): 726–728. doi : 10.2307 / 2371328 . JSTOR 2371328 .

- ^ Hosking, JRM, Wallis, JR (1997) Análisis de frecuencia regional: un enfoque basado en momentos L , Cambridge University Press. ISBN 0-521-43045-3 . Sección A.8

- ^ Documentación para el paquete lmomco R

![\ frac {1} {\ beta} - \ log \ left [\ frac {\ beta} {2 \ alpha \ Gamma (1 / \ beta)} \ right]](https://wikimedia.org/api/rest_v1/media/math/render/svg/05d168186ae96fb62acc10064e8112fac9ee71f2)

![{\ Displaystyle {\ begin {alineado} g '(\ beta) = {} & - {\ frac {\ psi (1 / \ beta)} {\ beta ^ {2}}} - {\ frac {\ psi' (1 / \ beta)} {\ beta ^ {3}}} + {\ frac {1} {\ beta ^ {2}}} - {\ frac {\ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta} (\ log | x_ {i} - \ mu |) ^ {2}} {\ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta}}} \\ [6pt] & {} + {\ frac {\ left (\ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta} \ log | x_ {i} - \ mu | \ right) ^ {2}} {\ left (\ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta } \ right) ^ {2}}} + {\ frac {\ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta} \ log | x_ {i} - \ mu |} {\ beta \ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta}}} \\ [6pt] & {} - {\ frac {\ log \ izquierda ({\ frac {\ beta} {N}} \ sum _ {i = 1} ^ {N} | x_ {i} - \ mu | ^ {\ beta} \ right)} {\ beta ^ {2} }}, \ end {alineado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/63da2dacce371da28eefe5751c8b34d381e939b1)

![{\ Displaystyle \ operatorname {E} \ left [X _ {\ beta} ^ {k} \ right] = {\ begin {cases} 0 & {\ text {if}} k {\ text {es impar,}} \\ \ alpha ^ {k} \ Gamma \ left ({\ frac {k + 1} {\ beta}} \ right) {\ Big /} \, \ Gamma \ left ({\ frac {1} {\ beta}} \ right) & {\ text {if}} k {\ text {es par.}} \ end {cases}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/08b61932a558eb204bfd8310603a9bb4c3ca5ef2)

![{\ Displaystyle \ beta \ in (0,2]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0da4e43d7bbe6cec9b435f914615dc3e71f2b5b9)

![{\ Displaystyle \ beta \ in (0,1] \ cup \ {2 \}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/60617d643b8dfeab3fa5c69b1affd3b5b591c189)

![y = \ begin {cases} - \ frac {1} {\ kappa} \ log \ left [1- \ frac {\ kappa (x- \ xi)} {\ alpha} \ right] & \ text {if} \ kappa \ neq 0 \\ \ frac {x- \ xi} {\ alpha} & \ text {if} \ kappa = 0 \ end {cases}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f27df77b4ee166d197260fc595f61dba5868d907)