En teoría de la probabilidad y estadísticas , kurtosis (de griego : κυρτός , kyrtos o Kürtös , que significa "curvado, arqueando") es una medida de la "tailedness" de la distribución de probabilidad de un verdadero -valued variable aleatoria . Al igual que la asimetría , la curtosis describe la forma de una distribución de probabilidad y hay diferentes formas de cuantificarla para una distribución teórica y las formas correspondientes de estimarla a partir de una muestra de una población. Las diferentes medidas de curtosis pueden tener diferentes interpretaciones .

La medida estándar de la curtosis de una distribución, originada con Karl Pearson , [1] es una versión escalada del cuarto momento de la distribución. Este número está relacionado con las colas de la distribución, no con su pico; [2] por lo tanto, la caracterización a veces vista de la curtosis como "pico" es incorrecta. Para esta medida, una mayor curtosis corresponde a una mayor extremidad de las desviaciones (o valores atípicos ), y no a la configuración de los datos cerca de la media .

La curtosis de cualquier distribución normal univariante es 3. Es común comparar la curtosis de una distribución con este valor. Se dice que las distribuciones con una curtosis menor de 3 son platicúrticas , aunque esto no implica que la distribución sea "plana" como se dice a veces. Más bien, significa que la distribución produce menos valores atípicos y menos extremos que la distribución normal. Un ejemplo de distribución platicúrtica es la distribución uniforme , que no produce valores atípicos. Se dice que las distribuciones con curtosis superior a 3 son leptocurticas . Un ejemplo de distribución leptocúrtica es la distribución de Laplace., que tiene colas que asintóticamente se acercan a cero más lentamente que una gaussiana y, por lo tanto, produce más valores atípicos que la distribución normal. También es una práctica común utilizar una versión ajustada de la curtosis de Pearson, la curtosis en exceso, que es la curtosis menos 3, para proporcionar la comparación con la distribución normal estándar . Algunos autores usan "curtosis" por sí misma para referirse al exceso de curtosis. Sin embargo, para mayor claridad y generalidad, este artículo sigue la convención de no exceso e indica explícitamente dónde se entiende el exceso de curtosis.

Las medidas alternativas de curtosis son: la L-curtosis , que es una versión escalada del cuarto momento L ; medidas basadas en cuatro cuantiles de población o muestra . [3] Son análogas a las medidas alternativas de asimetría que no se basan en momentos ordinarios. [3]

Momentos de Pearson

La curtosis es el cuarto momento estandarizado , definido como

donde μ 4 es el cuarto momento central y σ es la desviación estándar . En la literatura se utilizan varias letras para denotar la curtosis. Una opción muy común es κ , que está bien siempre que esté claro que no se refiere a un acumulativo . Otras opciones incluyen γ 2 , para ser similar a la notación de asimetría, aunque a veces esto se reserva para el exceso de curtosis.

La curtosis está limitada a continuación por la asimetría al cuadrado más 1: [4] : 432

donde μ 3 es el tercer momento central . El límite inferior se realiza mediante la distribución de Bernoulli . No existe un límite superior para la curtosis de una distribución de probabilidad general y puede ser infinito.

Una razón por la que algunos autores favorecen el exceso de curtosis es que los acumulados son extensos . Las fórmulas relacionadas con la propiedad extensiva se expresan de forma más natural en términos del exceso de curtosis. Por ejemplo, sean X 1 , ..., X n variables aleatorias independientes para las que existe el cuarto momento, y sea Y la variable aleatoria definida por la suma de X i . El exceso de curtosis de Y es

donde es la desviación estándar de . En particular, si todas las X i tienen la misma varianza, esto se simplifica a

La razón para no restar 3 es que el cuarto momento se generaliza mejor a distribuciones multivariadas , especialmente cuando no se asume la independencia. La cokurtosis entre pares de variables es un tensor de orden cuatro . Para una distribución normal bivariada, el tensor de cokurtosis tiene términos fuera de la diagonal que no son ni 0 ni 3 en general, por lo que intentar "corregir" un exceso se vuelve confuso. Sin embargo, es cierto que los acumulados conjuntos de grado mayor que dos para cualquier distribución normal multivariada son cero.

Para dos variables aleatorias, X e Y , no necesariamente independientes, la curtosis de la suma, X + Y , es

Tenga en cuenta que los coeficientes binomiales aparecen en la ecuación anterior.

Interpretación

La interpretación exacta de la medida de Pearson de curtosis (o exceso de curtosis) solía ser discutida, pero ahora está resuelta. Como señala Westfall en 2014 [2] , "... su única interpretación inequívoca es en términos de la extremidad de la cola, es decir, valores atípicos existentes (para la curtosis muestral) o propensión a producir valores atípicos (para la curtosis de una distribución de probabilidad). " La lógica es simple: la curtosis es el promedio (o valor esperado ) de los datos estandarizadoselevado a la cuarta potencia. Cualquier valor estandarizado que sea menor que 1 (es decir, datos dentro de una desviación estándar de la media, donde estaría el "pico"), prácticamente no contribuye en nada a la curtosis, ya que elevar un número menor que 1 a la cuarta potencia lo hace más cerca de cero. Los únicos valores de datos (observados u observables) que contribuyen a la curtosis de manera significativa son los que se encuentran fuera de la región del pico; es decir, los valores atípicos. Por lo tanto, la curtosis mide únicamente los valores atípicos; no mide nada sobre el "pico".

Se han dado muchas interpretaciones incorrectas de la curtosis que involucran nociones de punta. Una es que la curtosis mide tanto el "pico" de la distribución y el peso de su cola . [5] Se han sugerido varias otras interpretaciones incorrectas, como "falta de hombros" (donde el "hombro" se define vagamente como el área entre el pico y la cola, o más específicamente como el área alrededor de una desviación estándar de la media ) o "bimodalidad". [6] Balanda y MacGillivray afirman que la definición estándar de curtosis "es una mala medida de la curtosis, el pico o el peso de la cola de una distribución" [5] : 114y en su lugar proponen "definir la curtosis vagamente como el movimiento libre de ubicación y escala de la masa de probabilidad desde los hombros de una distribución hacia su centro y sus colas". [5]

Interpretación de los moros

En 1986 Moros dio una interpretación de la curtosis. [7] Deja

donde X es una variable aleatoria, μ es la media y σ es la desviación estándar.

Ahora, por definición de la curtosis , y por la conocida identidad

- .

La curtosis ahora puede verse como una medida de la dispersión de Z 2 alrededor de su expectativa. Alternativamente, puede verse como una medida de la dispersión de Z alrededor de +1 y -1. κ alcanza su valor mínimo en una distribución simétrica de dos puntos. En términos de la variable original X , la curtosis es una medida de la dispersión de X alrededor de los dos valores μ ± σ .

Los valores altos de κ surgen en dos circunstancias:

- donde la masa de probabilidad se concentra alrededor de la media y el proceso de generación de datos produce valores ocasionales lejos de la media,

- donde la masa de probabilidad se concentra en las colas de la distribución.

Exceso de curtosis

El exceso de curtosis se define como curtosis menos 3. Hay 3 regímenes distintos como se describe a continuación.

Mesokúrtico

Las distribuciones con cero exceso de curtosis se denominan mesocúrticas o mesocurtóticas. El ejemplo más destacado de una distribución mesocúrtica es la familia de distribución normal, independientemente de los valores de sus parámetros . Algunas otras distribuciones conocidas pueden ser mesocúrticas, dependiendo de los valores de los parámetros: por ejemplo, la distribución binomial es mesocúrtica para.

Leptokurtic

Una distribución con exceso de curtosis positiva se denomina leptocurtica o leptocurtótica. "Lepto-" significa "delgado". [8] En términos de forma, una distribución leptocúrtica tiene colas más gruesas . Los ejemplos de distribuciones leptocúrticas incluyen la distribución t de Student , la distribución de Rayleigh , la distribución de Laplace , distribución exponencial , distribución de Poisson y la distribución logística . Estas distribuciones a veces se denominan supergaussianas . [9]

Platykurtic

Una distribución con exceso de curtosis negativa se denomina platicurtica o platicurtótica. "Platy-" significa "amplio". [10] En términos de forma, una distribución platicúrtica tiene colas más delgadas . Los ejemplos de distribuciones platicúrticas incluyen las distribuciones uniformes continuas y discretas , y la distribución de coseno elevado . La distribución más platicúrtica de todas es la distribución de Bernoulli con p = 1/2 (por ejemplo, el número de veces que se obtiene "cara" cuando se lanza una moneda al aire, un lanzamiento de moneda ), para la cual el exceso de curtosis es -2. Estas distribuciones a veces se denominandistribución subgaussiana , propuesta originalmente por Jean-Pierre Kahane [11] y descrita con más detalle por Buldygin y Kozachenko. [12]

Ejemplos gráficos

La familia Pearson tipo VII

Los efectos de la curtosis se ilustran usando una familia paramétrica de distribuciones cuya curtosis se puede ajustar mientras sus momentos de orden inferior y acumulados permanecen constantes. Considere la familia de Pearson tipo VII , que es un caso especial de la familia de Pearson tipo IV restringida a densidades simétricas. La función de densidad de probabilidad está dada por

donde una es un parámetro de escala y m es un parámetro de forma .

Todas las densidades de esta familia son simétricas. El k- ésimo momento existe siempre que m > ( k + 1) / 2. Para que exista la curtosis, requerimos m > 5/2. Entonces existen la media y la asimetría y ambos son idénticamente cero. Establecer un 2 = 2 m - 3 hace que la varianza sea igual a la unidad. Entonces, el único parámetro libre es m , que controla el cuarto momento (y acumulativo) y, por tanto, la curtosis. Se puede reparametrizar con, donde es el exceso de curtosis como se definió anteriormente. Esto produce una familia leptocúrtica de un parámetro con media cero, varianza unitaria, asimetría cero y un exceso de curtosis arbitrario no negativo. La densidad reparametrizada es

En el limite como se obtiene la densidad

que se muestra como la curva roja en las imágenes de la derecha.

En la otra dirección como se obtiene la densidad normal estándar como distribución límite, que se muestra como la curva negra.

En las imágenes de la derecha, la curva azul representa la densidad con exceso de curtosis de 2. La imagen superior muestra que las densidades leptocúrticas en esta familia tienen un pico más alto que la densidad normal mesocúrtica, aunque esta conclusión solo es válida para esta selecta familia de distribuciones. Las colas comparativamente más gruesas de las densidades leptocúrticas se ilustran en la segunda imagen, que traza el logaritmo natural de las densidades de Pearson tipo VII: la curva negra es el logaritmo de la densidad normal estándar, que es una parábola . Se puede ver que la densidad normal asigna poca masa de probabilidad a las regiones alejadas de la media ("tiene colas delgadas"), en comparación con la curva azul de la densidad leptocúrtica de Pearson tipo VII con un exceso de curtosis de 2. Entre la curva azul y la negro son otras densidades de Pearson tipo VII con γ 2 = 1, 1/2, 1/4, 1/8 y 1/16. La curva roja muestra nuevamente el límite superior de la familia de Pearson tipo VII, con(lo que, estrictamente hablando, significa que el cuarto momento no existe). La curva roja disminuye más lentamente a medida que uno se mueve hacia afuera desde el origen ("tiene colas gruesas").

Otras distribuciones conocidas

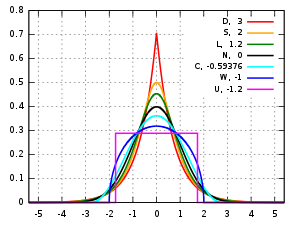

Aquí se comparan varias distribuciones unimodales y simétricas conocidas de diferentes familias paramétricas. Cada uno tiene una media y una asimetría de cero. Los parámetros se han elegido para dar como resultado una varianza igual a 1 en cada caso. Las imágenes de la derecha muestran curvas para las siguientes siete densidades, en escala lineal y escala logarítmica :

- D: distribución de Laplace , también conocida como distribución exponencial doble, curva roja (dos líneas rectas en la gráfica de escala logarítmica), exceso de curtosis = 3

- S: distribución secante hiperbólica , curva naranja, exceso de curtosis = 2

- L: distribución logística , curva verde, exceso de curtosis = 1,2

- N: distribución normal , curva negra (parábola invertida en la gráfica de escala logarítmica), exceso de curtosis = 0

- C: distribución de coseno elevado , curva cian, exceso de curtosis = −0,593762 ...

- W: distribución de semicírculo de Wigner , curva azul, exceso de curtosis = −1

- U: distribución uniforme , curva magenta (mostrada para mayor claridad como un rectángulo en ambas imágenes), exceso de curtosis = −1,2.

Nótese que en estos casos las densidades platicúrticas tienen soporte acotado , mientras que las densidades con curtosis en exceso positiva o cero se apoyan en toda la línea real .

No se puede inferir que las distribuciones de curtosis alta o baja tengan las características indicadas por estos ejemplos. Existen densidades platicúrticas con soporte infinito,

- por ejemplo, distribuciones de potencia exponenciales con un parámetro de forma suficientemente grande b

y existen densidades leptocúrticas con soporte finito.

- Por ejemplo, una distribución uniforme entre −3 y −0,3, entre −0,3 y 0,3, y entre 0,3 y 3, con la misma densidad en los intervalos (−3, −0,3) y (0,3, 3), pero con 20 veces más densidad en el intervalo (−0,3, 0,3)

Además, existen densidades platicúrticas con picos infinitos,

- por ejemplo, una mezcla igual de la distribución beta con los parámetros 0.5 y 1 con su reflexión alrededor de 0.0

y existen densidades leptocúrticas que parecen planas,

- por ejemplo, una mezcla de distribución uniforme entre -1 y 1 con una distribución t de Student T (4,0000001) , con probabilidades de mezcla de 0,999 y 0,001.

Muestra de curtosis

Definiciones

Un estimador natural pero sesgado

Para una muestra de n valores, un método de estimador de momentos del exceso de curtosis poblacional se puede definir como

donde m 4 es el cuarto momento muestral con respecto a la media , m 2 es el segundo momento muestral con respecto a la media (es decir, la varianza muestral ), x i es el i- ésimo valor yes la media muestral .

Esta fórmula tiene la representación más simple,

donde el los valores son los valores de datos estandarizados que utilizan la desviación estándar definida utilizando n en lugar de n - 1 en el denominador.

Por ejemplo, suponga que los valores de los datos son 0, 3, 4, 1, 2, 3, 0, 2, 1, 3, 2, 0, 2, 2, 3, 2, 5, 2, 3, 999.

Entonces la Los valores son −0,239, −0,225, −0,221, −0,234, −0,230, −0,225, −0,239, −0,230, −0,234, −0,225, −0,230, −0,239, −0,230, −0,230, −0,225, −0,230, −0,216, −0,230, −0,225, 4,359

y el los valores son 0.003, 0.003, 0.002, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.003, 0.002, 0.003, 0.003, 360.976.

El promedio de estos valores es 18.05 y el exceso de curtosis es 18.05 - 3 = 15.05. Este ejemplo deja en claro que los datos cerca del "medio" o "pico" de la distribución no contribuyen a la estadística de curtosis, por lo tanto, la curtosis no mide el "pico". Es simplemente una medida del valor atípico, 999 en este ejemplo.

Estimador insesgado estándar

Dado un subconjunto de muestras de una población, el exceso de curtosis de la muestra arriba es un estimador sesgado del exceso de curtosis poblacional. Un estimador alternativo del exceso de curtosis poblacional, que es insesgado en muestras aleatorias de distribución normal, se define de la siguiente manera: [3]

donde k 4 es el estimador insesgado simétrico único del cuarto acumulante , k 2 es la estimación insesgada del segundo acumulante (idéntica a la estimación insesgada de la varianza muestral), m 4 es el cuarto momento muestral con respecto a la media, m 2 es el segundo momento muestral sobre la media, x i es el i- ésimo valor, yes la media muestral. Este coeficiente de momento estandarizado de Fisher-Pearson ajustadoes la versión que se encuentra en Excel y varios paquetes estadísticos, incluidos Minitab , SAS y SPSS . [13]

Desafortunadamente, en muestras no normales en sí mismo está sesgado en general.

Límite superior

Un límite superior para la curtosis muestral de n ( n > 2) números reales es [14]

donde es la asimetría de la muestra correspondiente.

Varianza bajo normalidad

La varianza de la curtosis muestral de una muestra de tamaño n de la distribución normal es [15]

Dicho de otra manera, bajo el supuesto de que la variable aleatoria subyacente se distribuye normalmente, se puede demostrar que . [16] : número de página necesario

Aplicaciones

La curtosis muestral es una medida útil de si existe un problema con valores atípicos en un conjunto de datos. Una curtosis más grande indica un problema atípico más serio y puede llevar al investigador a elegir métodos estadísticos alternativos.

La prueba K-cuadrado de D'Agostino es una prueba de normalidad de bondad de ajuste basada en una combinación de la asimetría de la muestra y la curtosis de la muestra, al igual que la prueba de normalidad de Jarque-Bera .

Para muestras no normales, la varianza de la varianza muestral depende de la curtosis; para obtener más detalles, consulte la variación .

La definición de Pearson de curtosis se utiliza como indicador de intermitencia en turbulencias . [17]

Un ejemplo concreto es el siguiente lema de He, Zhang y Zhang: [18] Suponga una variable aleatoria tiene expectativa , varianza y curtosis . Supongamos que muestreamosmuchas copias independientes. Luego

- .

Esto muestra que con muchas muestras, veremos una que está por encima de la expectativa con probabilidad al menos . En otras palabras: si la curtosis es grande, es posible que veamos muchos valores por debajo o por encima de la media.

Convergencia de curtosis

Al aplicar filtros de paso de banda a imágenes digitales , los valores de curtosis tienden a ser uniformes, independientemente del rango del filtro. Este comportamiento, denominado convergencia de curtosis , se puede utilizar para detectar empalmes de imágenes en análisis forenses . [19]

Otras medidas

Se proporciona una medida diferente de "curtosis" mediante el uso de momentos L en lugar de los momentos ordinarios. [20] [21]

Ver también

- Riesgo de curtosis

- Distribución de probabilidad de entropía máxima

Referencias

- ^ Pearson, Karl (1905), "Das Fehlergesetz und seine Verallgemeinerungen durch Fechner und Pearson. Una réplica" [La ley del error y sus generalizaciones por Fechner y Pearson. Una dúplica], Biometrika , 4 (1–2): 169–212, doi : 10.1093 / biomet / 4.1-2.169 , JSTOR 2331536

- ↑ a b Westfall, Peter H. (2014), "Kurtosis as Peakedness, 1905 - 2014. RIP ", The American Statistician , 68 (3): 191-195, doi : 10.1080 / 00031305.2014.917055 , PMC 4321753 , PMID 25678714

- ↑ a b c Joanes, Derrick N .; Gill, Christine A. (1998), "Comparación de medidas de asimetría y curtosis de la muestra", Journal of the Royal Statistical Society, Serie D , 47 (1): 183–189, doi : 10.1111 / 1467-9884.00122 , JSTOR 2988433

- ^ Pearson, Karl (1916), "Contribuciones matemáticas a la teoría de la evolución. - XIX. Segundo suplemento de una memoria sobre variación sesgada". Transacciones filosóficas de la Royal Society of London A , 216 (546): 429-457, doi : 10.1098 / rsta.1916.0009 , JSTOR 91092

- ^ a b c Balanda, Kevin P .; MacGillivray, Helen L. (1988), "Kurtosis: A Critical Review", The American Statistician , 42 (2): 111-119, doi : 10.2307 / 2684482 , JSTOR 2684482

- ^ Darlington, Richard B. (1970), "Is Kurtosis Really 'Peakedness'?", The American Statistician , 24 (2): 19-22, doi : 10.1080 / 00031305.1970.10478885 , JSTOR 2681925

- ^ Moors, JJA (1986), "El significado de la curtosis: Darlington reexaminado", The American Statistician , 40 (4): 283-284, doi : 10.1080 / 00031305.1986.10475415 , JSTOR 2684603

- ^ "Lepto-" .

- ^ Benveniste, Albert; Goursat, Maurice; Ruget, Gabriel (1980), "Identificación robusta de un sistema de fase no mínima: ajuste ciego de un ecualizador lineal en comunicaciones de datos", IEEE Transactions on Automatic Control , 25 (3): 385–399, doi : 10.1109 / tac.1980.1102343

- ^ http://www.yourdictionary.com/platy-prefix

- ^ Kahane, Jean-Pierre (1960), "Propriétés locales des fonctions à séries de Fourier aléatoires" [Propiedades locales de funciones en términos de series aleatorias de Fourier], Studia Mathematica (en francés), 19 (1): 1–25, doi : 10.4064 / sm-19-1-1-25

- ↑ Buldygin, Valerii V .; Kozachenko, Yuriy V. (1980), "Variables aleatorias subgaussianas", Ucraniano Mathematical Journal , 32 (6): 483–489, doi : 10.1007 / BF01087176

- ^ Doane DP, Seward LE (2011) J Stat Educ 19 (2)

- ^ Sharma, Rajesh; Bhandari, Rajeev K. (2015), "Asimetría, curtosis y desigualdad de Newton", Rocky Mountain Journal of Mathematics , 45 (5): 1639–1643, doi : 10.1216 / RMJ-2015-45-5-1639

- ^ Fisher, Ronald A. (1930), "Los momentos de la distribución de muestras normales de medidas de desviación de la normalidad", Actas de la Royal Society A , 130 (812): 16-28, doi : 10.1098 / rspa.1930.0185 , JSTOR 95586

- ^ Kendall, Maurice G .; Stuart, Alan, The Advanced Theory of Statistics, Volumen 1: Teoría de la distribución (3.a ed.), Londres, Reino Unido: Charles Griffin & Company Limited, ISBN 0-85264-141-9

- ^ Sandborn, Virgil A. (1959), "Medidas de la intermitencia del movimiento turbulento en una capa límite", Journal of Fluid Mechanics , 6 (2): 221-240, doi : 10.1017 / S0022112059000581

- ^ Él, S .; Zhang, J .; Zhang, S. (2010). "Límite de probabilidad de pequeña desviación: un enfoque de cuarto momento" . Matemáticas de la investigación operativa . 35 (1): 208–232. doi : 10.1287 / moor.1090.0438 .

- ^ Pan, Xunyu; Zhang, Xing; Lyu, Siwei (2012), "Exposición de empalmes de imágenes con variaciones de ruido locales inconsistentes", Conferencia internacional de IEEE sobre fotografía computacional (ICCP) de 2012, 28-29 de abril de 2012; Seattle, WA, EE. UU .: IEEE, doi : 10.1109 / ICCPhot.2012.6215223Mantenimiento de CS1: ubicación ( enlace )

- ^ Hosking, Jonathan RM (1992), "¿Momentos o momentos L ? Un ejemplo que compara dos medidas de forma distributiva", The American Statistician , 46 (3): 186–189, doi : 10.1080 / 00031305.1992.10475880 , JSTOR 2685210

- ↑ Hosking, Jonathan RM (2006), "Sobre la caracterización de distribuciones por sus momentos L ", Journal of Statistical Planning and Inference , 136 (1): 193-198, doi : 10.1016 / j.jspi.2004.06.004

Lectura adicional

- Kim, Tae-Hwan; White, Halbert (2003). "Sobre una estimación más sólida de la asimetría y la curtosis: simulación y aplicación al índice S & P500" . Cartas de investigación financiera . 1 : 56–70. doi : 10.1016 / S1544-6123 (03) 00003-5 . Fuente alternativa (Comparación de estimadores de curtosis)

- Seier, E .; Bonett, DG (2003). "Dos familias de medidas de curtosis". Metrika . 58 : 59–70. doi : 10.1007 / s001840200223 .

Enlaces externos

- "Exceso de coeficiente" , Enciclopedia de Matemáticas , EMS Press , 2001 [1994]

- Calculadora de curtosis

- El software gratuito en línea (calculadora) calcula varios tipos de estadísticas de asimetría y curtosis para cualquier conjunto de datos (incluye pruebas de muestra pequeñas y grandes).

- Curtosis sobre los primeros usos conocidos de algunas de las palabras de las matemáticas

- Celebrando 100 años de curtosis una historia del tema, con diferentes medidas de curtosis.

![{\ Displaystyle \ operatorname {Kurt} [X] = \ operatorname {E} \ left [\ left ({\ frac {X- \ mu} {\ sigma}} \ right) ^ {4} \ right] = {\ frac {\ operatorname {E} \ left [(X- \ mu) ^ {4} \ right]} {\ left (\ operatorname {E} \ left [(X- \ mu) ^ {2} \ right] \ derecha) ^ {2}}} = {\ frac {\ mu _ {4}} {\ sigma ^ {4}}},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/abb6badbf13364972b05d9249962f5ff87aba236)

![{\ Displaystyle \ operatorname {Kurt} [Y] -3 = {\ frac {1} {\ left (\ sum _ {j = 1} ^ {n} \ sigma _ {j} ^ {\, 2} \ right ) ^ {2}}} \ sum _ {i = 1} ^ {n} \ sigma _ {i} ^ {\, 4} \ cdot \ left (\ operatorname {Kurt} \ left [X_ {i} \ right ] -3 \ derecha),}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8f295e334581a6f264d3ca40bf75df3293fb0f3e)

![{\ Displaystyle \ operatorname {Kurt} [Y] -3 = {1 \ over n ^ {2}} \ sum _ {i = 1} ^ {n} \ left (\ operatorname {Kurt} \ left [X_ {i } \ right] -3 \ right).}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6c397ae36f0e23dd0fff0c1137e5dcddc2e9217b)

![{\ Displaystyle {\ begin {alineado} \ operatorname {Kurt} [X + Y] = {1 \ over \ sigma _ {X + Y} ^ {4}} {\ big (} & \ sigma _ {X} ^ {4} \ operatorname {Kurt} [X] +4 \ sigma _ {X} ^ {3} \ sigma _ {Y} \ operatorname {Cokurt} [X, X, X, Y] \\ & {} + 6 \ sigma _ {X} ^ {2} \ sigma _ {Y} ^ {2} \ operatorname {Cokurt} [X, X, Y, Y] \\ [6pt] & {} + 4 \ sigma _ {X} \ sigma _ {Y} ^ {3} \ operatorname {Cokurt} [X, Y, Y, Y] + \ sigma _ {Y} ^ {4} \ operatorname {Kurt} [Y] {\ big)}. \ final {alineado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ca0a7f4889310fb96ed071c23a6d6af959ef500d)

![{\ Displaystyle E \ left [V ^ {2} \ right] = \ operatorname {var} [V] + [E [V]] ^ {2},}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6782f578cb9d22c509a08ab7d43a21735eba1cde)

![{\ Displaystyle \ kappa = E \ left [Z ^ {4} \ right] = \ operatorname {var} \ left [Z ^ {2} \ right] + \ left [E \ left [Z ^ {2} \ right ] \ right] ^ {2} = \ operatorname {var} \ left [Z ^ {2} \ right] + [\ operatorname {var} [Z]] ^ {2} = \ operatorname {var} \ left [Z ^ {2} \ right] +1}](https://wikimedia.org/api/rest_v1/media/math/render/svg/8ed2d37d4494e13b10f81b83797c0d689ff740d2)

![f (x; a, m) = \ frac {\ Gamma (m)} {a \, \ sqrt {\ pi} \, \ Gamma (m-1/2)} \ left [1+ \ left (\ frac {x} {a} \ right) ^ 2 \ right] ^ {- m}, \!](https://wikimedia.org/api/rest_v1/media/math/render/svg/688a4a90b74edb0216f35dd7fd915132f37599f8)

![{\ Displaystyle g_ {2} = {\ frac {m_ {4}} {m_ {2} ^ {2}}} - 3 = {\ frac {{\ tfrac {1} {n}} \ sum _ {i = 1} ^ {n} (x_ {i} - {\ overline {x}}) ^ {4}} {\ left [{\ tfrac {1} {n}} \ sum _ {i = 1} ^ { n} (x_ {i} - {\ overline {x}}) ^ {2} \ right] ^ {2}}} - 3}](https://wikimedia.org/api/rest_v1/media/math/render/svg/e30ed8db4466ff3e448b71e729464506ddce7770)

![{\ Displaystyle {\ begin {alineado} G_ {2} & = {\ frac {k_ {4}} {k_ {2} ^ {2}}} \\ [6pt] & = {\ frac {n ^ {2 } \, [(n + 1) \, m_ {4} -3 \, (n-1) \, m_ {2} ^ {2}]} {(n-1) \, (n-2) \ , (n-3)}} \; {\ frac {(n-1) ^ {2}} {n ^ {2} \, m_ {2} ^ {2}}} \\ [6pt] & = { \ frac {n-1} {(n-2) \, (n-3)}} \ left [(n + 1) \, {\ frac {m_ {4}} {m_ {2} ^ {2} }} - 3 \, (n-1) \ right] \\ [6pt] & = {\ frac {n-1} {(n-2) \, (n-3)}} \ left [(n + 1) \, g_ {2} +6 \ right] \\ [6pt] & = {\ frac {(n + 1) \, n \, (n-1)} {(n-2) \, (n -3)}} \; {\ frac {\ sum _ {i = 1} ^ {n} (x_ {i} - {\ bar {x}}) ^ {4}} {\ left [\ sum _ { i = 1} ^ {n} (x_ {i} - {\ bar {x}}) ^ {2} \ right] ^ {2}}} - 3 \, {\ frac {(n-1) ^ { 2}} {(n-2) \, (n-3)}} \\ [6pt] & = {\ frac {(n + 1) \, n} {(n-1) \, (n-2 ) \, (n-3)}} \; {\ frac {\ sum _ {i = 1} ^ {n} (x_ {i} - {\ bar {x}}) ^ {4}} {k_ { 2} ^ {2}}} - 3 \, {\ frac {(n-1) ^ {2}} {(n-2) (n-3)}} \ end {alineado}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1d415f4bfc7b3c661cae851860e8cf18e5d98515)

![{\ Displaystyle E [X] = \ mu}](https://wikimedia.org/api/rest_v1/media/math/render/svg/51ed977b56d8e513d9eb92193de5454ac545231e)

![{\ Displaystyle E \ left [(X- \ mu) ^ {2} \ right] = \ sigma ^ {2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cedd17629b1a84a72ee82ac046028e7628811148)

![{\ Displaystyle \ kappa = {\ tfrac {1} {\ sigma ^ {4}}} E \ left [(X- \ mu) ^ {4} \ right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f9596b45af565b781abac4f4bad3ae95dc48f57f)

![{\ Displaystyle \ Pr \ left [\ max _ {i = 1} ^ {n} X_ {i} \ leq \ mu \ right] \ leq \ delta \ quad {\ text {y}} \ quad \ Pr \ left [\ min _ {i = 1} ^ {n} X_ {i} \ geq \ mu \ right] \ leq \ delta}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7dd308935ef5c101697f8d1f64b76d7e42591ad6)