entropía

La entropía es un concepto científico, así como una propiedad física medible que se asocia más comúnmente con un estado de desorden, aleatoriedad o incertidumbre. El término y el concepto se utilizan en diversos campos, desde la termodinámica clásica , donde se reconoció por primera vez, hasta la descripción microscópica de la naturaleza en la física estadística y los principios de la teoría de la información . Ha encontrado aplicaciones de gran alcance en química y física , en sistemas biológicos y su relación con la vida, en cosmología , economía , sociología , climatología , cambio climático ysistemas de información, incluida la transmisión de información en telecomunicaciones . [1]

El científico e ingeniero escocés Macquorn Rankine se refirió al concepto de termodinámica en 1850 con los nombres de función termodinámica y potencial de calor . [2] En 1865, el físico alemán Rudolf Clausius , uno de los principales fundadores del campo de la termodinámica, la definió como el cociente entre una cantidad infinitesimal de calor y la temperatura instantánea . Inicialmente lo describió como contenido de transformación , en alemán Verwandlungsinhalt , y luego acuñó el término entropía de una palabra griega para transformación .. Refiriéndose a la constitución y estructura microscópica, en 1862, Clausius interpretó el concepto en el sentido de disgregación . [3]

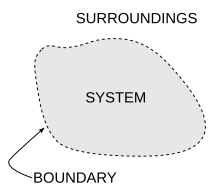

Una consecuencia de la entropía es que ciertos procesos son irreversibles o imposibles, además del requisito de no violar la conservación de la energía , esta última expresada en la primera ley de la termodinámica . La entropía es fundamental para la segunda ley de la termodinámica , que establece que la entropía de los sistemas aislados que se dejan en evolución espontánea no puede disminuir con el tiempo, ya que siempre llegan a un estado de equilibrio termodinámico , donde la entropía es más alta.

El físico austriaco Ludwig Boltzmann explicó la entropía como la medida del número de arreglos o estados microscópicos posibles de átomos y moléculas individuales de un sistema que cumplen con la condición macroscópica del sistema. Introdujo así el concepto de desorden estadístico y distribuciones de probabilidad en un nuevo campo de la termodinámica, llamado mecánica estadística , y encontró el vínculo entre las interacciones microscópicas, que fluctúan alrededor de una configuración promedio, con el comportamiento observable macroscópicamente, en forma de un logarítmico simple. ley, con una constante de proporcionalidad , la constante de Boltzmann, que se ha convertido en una de las constantes universales definitorias del moderno Sistema Internacional de Unidades (SI).

En 1948, el científico de Bell Labs , Claude Shannon , desarrolló conceptos estadísticos similares para medir la incertidumbre microscópica y la multiplicidad para el problema de las pérdidas aleatorias de información en las señales de telecomunicaciones. Por sugerencia de John von Neumann , Shannon nombró entropía a esta entidad de información faltante de manera análoga a su uso en la mecánica estadística , y dio origen al campo de la teoría de la información . Esta descripción ha sido identificada como una definición universal del concepto de entropía. [4]